科技日報記者 張佳欣

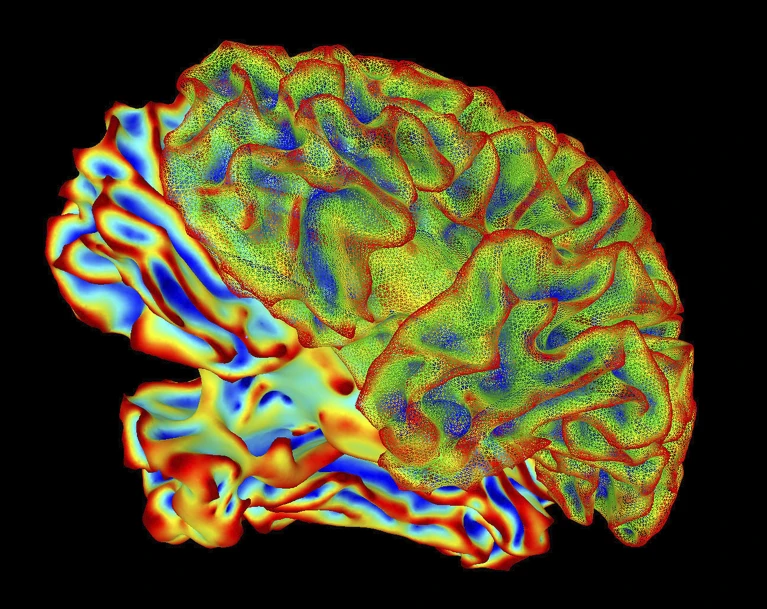

人工智能(AI)“讀心術(shù)”可通過讀取大腦活動,“看懂”人腦中的畫面——這聽起來像科幻小說,如今卻離現(xiàn)實更進一步。日本NTT通信科學(xué)實驗室研究團隊開發(fā)出一種名為“心智字幕”的新技術(shù),能利用AI模型,根據(jù)受試者大腦活動生成其所見或腦中想象畫面的文字描述,準確度非常高。研究成果發(fā)表于新一期《科學(xué)進展》雜志。

這一技術(shù)不僅揭示了人腦如何在語言形成前表征外部世界,還有望幫助因中風(fēng)等原因?qū)е抡Z言障礙的患者,通過腦機接口更順暢地表達想法。

要解碼大腦對復(fù)雜內(nèi)容的理解,例如短視頻或抽象形狀,一直具有挑戰(zhàn)性。此前研究大多只能提取出關(guān)鍵詞,難以還原完整語境,例如視頻的主角是誰、發(fā)生了什么動作。

為突破這一瓶頸,研究團隊設(shè)計了雙重AI模型。他們先利用深度語言AI模型分析了兩千多段視頻的文字說明,并將每段說明轉(zhuǎn)化為獨特的“意義特征”。隨后團隊通過功能性磁共振成像記錄6名受試者觀看視頻時的大腦活動,并訓(xùn)練第二個AI系統(tǒng),學(xué)習(xí)將腦信號與這些意義特征對應(yīng)起來。

當(dāng)模型訓(xùn)練完成后,系統(tǒng)即可通過新的腦掃描數(shù)據(jù)預(yù)測受試者所看到內(nèi)容的意義特征,并生成最接近的句子描述。例如,一名受試者觀看了一個人從瀑布頂端跳下的視頻。AI模型通過其大腦活動,先后生成一系列詞串,從最初的“泉水流動”,到第十次猜測的“在急速落下的瀑布上方”,最終在第100次猜測時生成句子:“一個人從山頂?shù)钠俨家卉S而下”。這幾乎完全還原了完整的視頻內(nèi)容。

更令人驚訝的是,當(dāng)受試者回憶先前看過的視頻片段時,AI模型仍能根據(jù)大腦的回憶生成準確的文字描述。這表明,人腦在觀看與回憶時使用了相似的內(nèi)部表征方式。

英國《自然》雜志評論稱,這項基于非侵入式功能性磁共振成像的技術(shù),未來有望推動腦機接口的發(fā)展,使植入設(shè)備能更直接地將人的思維轉(zhuǎn)化為文字或語音,從而幫助語言受損者恢復(fù)交流能力。

總編輯圈點

當(dāng)腦機接口遇上人工智能,“心有靈犀”正從浪漫想象步入現(xiàn)實。其原理是,當(dāng)我們看視頻或畫面時,大腦會發(fā)出各種各樣的神經(jīng)信號,腦機接口技術(shù)負責(zé)捕捉這些信號,而人工智能模型則負責(zé)解碼和重構(gòu)這些信號,一場科幻般的“讀心術(shù)”便順利完成。這意味著,借助這種技術(shù),人類通過在大腦中想象畫面,就可以將所思所想傳遞給另一個人,從而實現(xiàn)真正意義上的“意念交流”。